По нашим данным в BotHunt, через поведенческих ботов сегодня проходит от 8% до 40% всего трафика из Яндекса — в зависимости от ниши. У агрегаторов, интернет-магазинов и юридических услуг доля доходит до половины. И это не безобидные визиты: боты-накрутчики портят метрики, роняют позиции в выдаче и подводят ваш сайт под алгоритм Тайфун, запущенный Яндексом в 2025 году. Защита от накрутки поведенческих факторов из экзотической услуги для SEO-энтузиастов превратилась в обязательный слой безопасности — наравне с SSL-сертификатом.

В этом руководстве разбираем, что такое накрутка ПФ в 2026 году, как она работает технически, какие санкции грозят жертвам атаки и — главное — девять рабочих методов защиты. Даём сравнительную таблицу, пошаговый план запуска защиты за 1 день и чек-лист ошибок, которые владельцы сайтов совершают чаще всего.

Что такое накрутка поведенческих факторов и чем она опасна

Поведенческие факторы (ПФ) — это метрики, которые Яндекс собирает через поиск и Метрику, чтобы понять, насколько сайт решает задачу пользователя. В формулу ранжирования входят время на сайте, глубина просмотра, возвраты в выдачу («кликнул и через 5 секунд вернулся» — плохой сигнал), прямые заходы, повторные визиты, доля кликов по брендовому запросу и десятки других показателей.

Накрутка поведенческих факторов — это автоматизированная имитация «идеального пользователя»: заход из выдачи по нужному запросу, медленный скролл, переходы по внутренним ссылкам, длинная сессия, добавление в закладки. Боты делают это на масштабе, которого не способен обеспечить живой трафик, и систематически искажают формулу ранжирования.

Для вашего сайта это опасно с двух сторон:

Позитивная накрутка — когда кто-то (вы или SEO-подрядчик) заказал её, пытаясь поднять сайт. При обнаружении грозит фильтр Тайфун и потеря трафика на 8–18 месяцев.

Негативная накрутка — когда конкурент наливает на ваш сайт «плохой» бот-трафик: короткие сессии, мгновенные возвраты. Результат тот же — просадка позиций, хотя вы ничего не заказывали.

В нашей практике чаще встречается второй сценарий: конкурент в конкурентной нише за 5–15 тысяч рублей в месяц покупает на биржах сервис и «топит» соседей в ТОП-10. Поэтому защита от накрутки поведенческих факторов нужна даже тем, кто сам никогда такого не заказывал.

Дополнительный риск — искажение вашей собственной аналитики. Если в Метрике 30% трафика составляют боты, отчёты по конверсии, LTV и окупаемости каналов перестают быть точными. Решения, которые принимает маркетинг на таких данных, оказываются ошибочными: масштабируется не то, что приносит деньги, а то, что накручено.

Как накрутчики имитируют реальных пользователей

Чтобы понимать, как правильно защищаться, нужно знать, чем вооружён противник. В 2026 году массовая накрутка строится на двух платформах: Browser Automation Studio (BAS) и ZennoPoster. Это среды для автоматизации браузерных действий: они поднимают реальный Chrome-движок, загружают страницы, двигают мышь, скроллят и кликают.

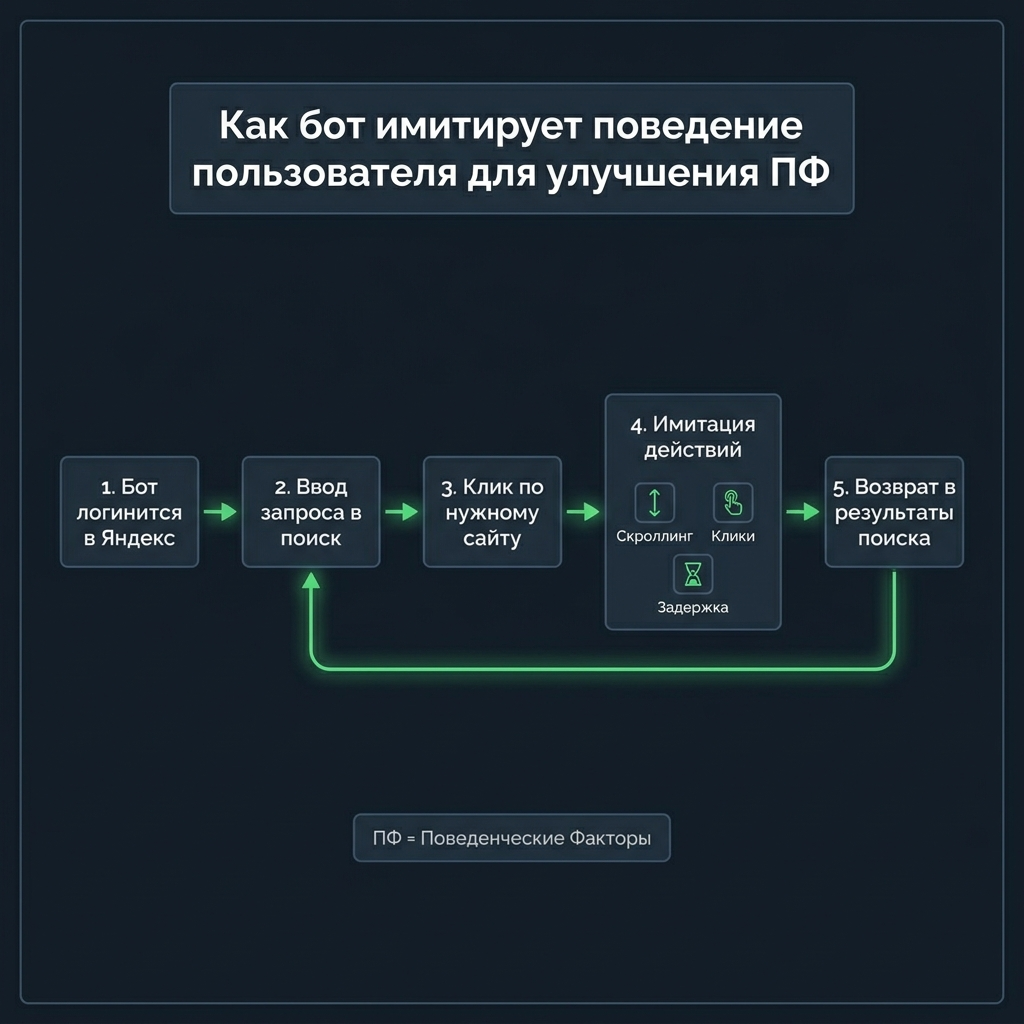

Типовой сценарий визита бота-накрутчика:

Скрипт открывает Яндекс через резидентный прокси нужного региона.

Вводит заранее подготовленный запрос (часто — с опечатками, чтобы выглядело по-человечески).

Листает выдачу до нужного сайта, кликает по нему.

На сайте — скроллит с рваной скоростью, кликает по 2–3 внутренним ссылкам, задерживается 1,5–3 минуты.

Закрывает вкладку, сбрасывает сессию, меняет прокси и повторяет с другим запросом.

На одну «накатку» обычно тратится 200–500 визитов в сутки по ключевой фразе. Этого достаточно, чтобы заметно сдвинуть позиции в низкочастотке и среднечастотке. В высокочастотных запросах бюджет кратно выше, но и там отдача видна за 10–14 дней.

Главная сложность в детекции: такой бот на 90% похож на живого человека. Капча его не ловит — он её не встречает, потому что ходит по публичным страницам. User-Agent — обычный Chrome на Windows 11. IP — резидентный, принадлежит бытовому провайдеру. Поэтому фильтры на уровне robots.txt или статичных IP-черных списков не работают в принципе. Подробнее о технике имитации — в нашем разборе «Как бот имитирует пользователя».

Алгоритм Тайфун и санкции Яндекса в 2025–2026

В 2025 году Яндекс запустил алгоритм «Тайфун» — это не отдельный фильтр, а встроенная в формулу ранжирования антифрод-модель, которая в реальном времени оценивает долю имитации в трафике и корректирует оценку сайта. До Тайфуна антифрод работал как пост-фактум: ботов обнаруживали, потом накладывали санкции. Теперь оценка происходит на лету, и «грязный» трафик просто перестаёт учитываться при расчёте позиций.

Параллельно Яндекс стал активно уведомлять владельцев в Вебмастере. Увидеть предупреждение можно в разделе Безопасность и нарушения — там появляется сообщение:

Обнаружена имитация действий пользователей. Рекомендуем проверить сайт и обеспечить, чтобы на него не шёл искусственный трафик.

После предупреждения у сайта есть окно, чтобы принять меры. Если ситуация не меняется — включается фильтр: трафик из органики падает на 40–90% и восстанавливается только через 8–18 месяцев. По нашим наблюдениям, 2 из 3 сайтов, получивших фильтр, сами не заказывали накрутку: их «топили» конкуренты.

Ключевой вывод: защита от накрутки поведенческих факторов нужна даже если вы «белый» оптимизатор. Яндекс не делит жертв и исполнителей — он видит грязный трафик и снижает доверие к домену. Подробно про выход из-под фильтра — в нашей статье «Фильтр Яндекса за накрутку ПФ: как выйти и не попасть снова».

Подключите BotHunt бесплатно на 14 дней — установка занимает 1 минуту, и вы сразу увидите, сколько ботов ходит по вашему сайту. Запустить защиту →

9 методов защиты от накрутки поведенческих факторов

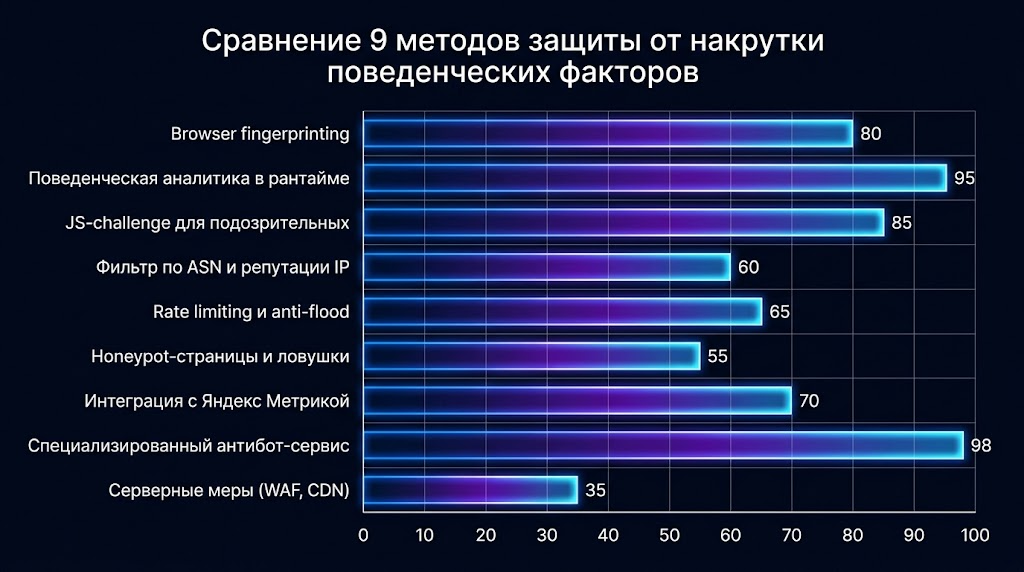

Ни один метод в отдельности не даёт стопроцентной защиты. Современные накрутчики обходят любое одиночное правило. Работает только многослойная защита, где бот должен пройти 3–4 независимых проверки подряд. Ниже — девять методов с честной оценкой эффективности и сложности.

№ | Метод | Эффективность | Ложные срабатывания | Сложность |

|---|---|---|---|---|

1 | Browser fingerprinting | Высокая | Низкие | Средняя |

2 | Поведенческая аналитика в рантайме | Очень высокая | Низкие | Высокая |

3 | JS-challenge для подозрительных | Высокая | Средние | Средняя |

4 | Фильтр по ASN и репутации IP | Средняя | Низкие | Низкая |

5 | Rate limiting и anti-flood | Средняя | Низкие | Низкая |

6 | Honeypot-страницы и ловушки | Средняя | Нулевые | Средняя |

7 | Интеграция с Яндекс Метрикой | Средняя | Низкие | Низкая |

8 | Специализированный антибот-сервис | Очень высокая | Очень низкие | Низкая |

9 | Серверные меры (WAF, CDN) | Низкая для ПФ | Низкие | Средняя |

Метод 1. Browser fingerprinting

Fingerprinting — сбор «цифрового отпечатка» браузера: canvas, WebGL-рендер, шрифты, плагины, разрешение экрана, часовой пояс, особенности TLS-рукопожатия. Даже если накрутчик меняет IP и User-Agent, полный отпечаток браузера остаётся уникальным и повторяется на сотнях визитов. Это — сильнейший сигнал детекции.

Мы в BotHunt собираем около 120 fingerprint-сигналов за первые 50 мс визита. Боты на BAS и ZennoPoster оставляют характерные следы: одинаковый canvas-хеш на разных IP, подозрительная связка JA3-отпечатка TLS с User-Agent, стандартные значения WebGL. Фильтрация по fingerprint даёт точность детекции около 95% при минимуме ложных срабатываний и стоит первым рубежом обороны.

Важное уточнение: fingerprinting работает только на стороне клиента и требует подключения JavaScript-агента. Тем, кто защищает сайт серверными средствами (только Nginx/CDN), этот метод недоступен, и они существенно проигрывают в точности.

Метод 2. Поведенческая аналитика в реальном времени

Если fingerprint отвечает на вопрос «кто это», поведенческая аналитика отвечает на вопрос «как он себя ведёт». Модель смотрит на движение мыши (живой человек делает микро-дрожание, бот — прямые отрезки), скорость и паузы при скролле, последовательность кликов, задержки между действиями. Накрутчики стараются имитировать человека, но статистически попадают в распределение ботов.

Главный плюс метода — он не зависит от того, насколько хорошо бот маскируется на сетевом уровне. Главный минус — требует ML-модели, обученной на большом объёме трафика. Самостоятельно выстроить такое сложно: типичный SaaS-антибот обучается на миллиардах визитов в месяц. Для отдельного сайта эти данные недоступны, поэтому поведенческую аналитику разумно получать как часть готового сервиса.

Метод 3. JS-challenge для подозрительных визитов

Подозрительному клиенту до рендеринга страницы ставится лёгкая задача на JavaScript: вычислить короткий ответ, подписать токен, пройти proof-of-work. Реальный браузер справляется за 50–200 мс, пользователь ничего не замечает. Примитивные боты на HTTP-клиентах (без браузера) отваливаются. Продвинутые боты на реальном Chromium проходят, но расходуют ресурсы — для накрутчика растёт стоимость визита в 5–10 раз, и бюджет атаки становится нерентабельным.

JS-challenge хорошо работает как второй рубеж после fingerprinting: он не мешает чистым визитам, но усложняет жизнь автоматизации. В BotHunt challenge применяется только к визитам со score выше порога — это удерживает ложные срабатывания на уровне ниже 0,05%. Прозрачный challenge без видимой капчи — стандарт индустрии 2026 года.

Метод 4. Фильтрация по ASN и репутации IP

ASN (Autonomous System Number) — это «адрес» сети провайдера. У дата-центров, хостингов и VPN-сервисов ASN легко отличаются от бытовых провайдеров. Если визит по коммерческому запросу приходит с ASN облачного хостинга — это почти наверняка автоматизация. Накрутчики знают это и используют резидентные прокси (IP бытовых абонентов), но даже там есть «грязные» диапазоны, которые раз за разом попадают в базы антифродов.

Метод хорош как первый быстрый отсев: по нашей статистике, он убирает до 25–35% бот-трафика без каких-либо других проверок. Дальше остаются более хитрые визиты, которые ловятся уже поведенческими методами. Подробно о работе ASN-фильтрации мы пишем в отдельной статье про резидентные прокси.

Метод 5. Rate limiting и anti-flood

Простая, но полезная мера: ограничение количества запросов с одного IP в минуту/час. Для накрутки ПФ этот метод ловит не основную массу (там каждый визит с уникального прокси), но отсекает вспомогательные атаки — парсинг, брутфорс, massive-curl. Настраивается на уровне Nginx, Cloudflare-совместимых решений или на агенте антибот-сервиса.

Важно не переборщить: слишком жёсткий лимит режет живых пользователей мобильных операторов, где сотни абонентов выходят через один NAT. Мы рекомендуем лимит не по факту запросов, а по сумме «подозрительного поведения + скорости» — адаптивный rate limit, который учитывает score клиента.

Метод 6. Honeypot-страницы и ловушки

Honeypot — это страница или ссылка, которую видят только автоматизированные обходы, но не живой пользователь. Например, скрытая через CSS ссылка «admin-pricing.html», на которую никогда не кликнет человек, но скрипт, тупо обходящий DOM, зайдёт. Все IP и fingerprint'ы, попавшие на ловушку, автоматически помечаются как боты на 30 дней.

Метод хорош нулём ложных срабатываний (реальный человек просто не дойдёт до ловушки) и тем, что противник не знает, куда смотреть. В BotHunt honeypot-слой работает автоматически: агент раскидывает по сайту 3–5 невидимых маркеров и ведёт их в общую модель скоринга. Ловушки особенно эффективны против ботов на базе headless Chrome, которые обходят DOM через querySelectorAll и попадаются на скрытых элементах.

Метод 7. Интеграция с Яндекс Метрикой

Яндекс Метрика сама помечает часть визитов как роботов и показывает отчёт «Роботы». Эти данные можно выгружать через API и использовать для настройки корректировок в Директе и для сегментов исключения. Минус — Метрика видит ботов постфактум и далеко не всех: умная накрутка нужна, чтобы обмануть именно её, поэтому и не светится в отчёте.

Мы рекомендуем использовать Метрику как дополнительный сигнал, а не основной рубеж. Фиксируйте в Метрике цели (достижение страниц), и если на сайте резко выросла доля визитов без целей — это повод проверить защиту. Официальные рекомендации Яндекса по работе с роботами в Метрике есть в справке Яндекс Метрики.

Метод 8. Специализированный антибот-сервис

Самый сильный способ — подключить готовый сервис, у которого внутри уже собраны методы 1–6, обучены ML-модели и есть база репутации на миллионах фингерпринтов. Такой сервис ставится как агент (одна строка кода или плагин CMS), анализирует каждый визит в реальном времени и отдаёт вердикт: пропустить, challenge, заблокировать.

BotHunt — российская реализация такого сервиса, ориентированная на защиту именно от накрутки ПФ в Яндексе. Агент срабатывает за <100 мс, точность детекции поведенческих ботов — 99,9%, ложных срабатываний — менее 0,05%. Поисковые роботы (YandexBot, GoogleBot) автоматически пропускаются по обратному DNS, так что на индексацию защита не влияет. Помимо фильтрации по fingerprint и поведению, учитывается репутация ASN, velocity-метрики и десятки других сигналов.

Метод 9. Серверные меры: WAF, CDN, geo-blocking

Классические меры уровня инфраструктуры. WAF (Web Application Firewall) фильтрует инъекции и атаки на веб-приложение, CDN раскидывает нагрузку, geo-blocking отсекает трафик из стран, где у вас нет клиентов. Против накрутки ПФ эти меры работают слабо: накрутчики заходят с российских IP и не делают ничего, что отличалось бы от живого пользователя по HTTP. Но они полезны как часть общей гигиены. Подробнее о разнице — в материале «WAF vs антибот: в чём разница».

Рассчитайте, сколько стоит защита для вашего сайта — тарифы начинаются с фиксированной суммы без переплат за трафик. Посмотреть тарифы →

Пошаговая инструкция: запуск защиты за 1 день

План действий, который мы рекомендуем владельцам сайтов, впервые столкнувшимся с подозрением на накрутку. Общий срок — 4–6 часов работы, эффект — заметный в Метрике уже на следующий день.

Диагностика. В Метрике откройте отчёт «Источники — Поисковые системы» за последние 14 дней. Сравните среднее время на сайте, отказы и глубину просмотра по Яндексу и Google. Если по Яндексу показатели внезапно ухудшились или, наоборот, «идеальные» — это сигнал.

Проверка Вебмастера. Зайдите в Яндекс Вебмастер, раздел «Безопасность и нарушения». Наличие уведомления о накрутке — повод срочно действовать. Отсутствие не означает, что всё хорошо: Тайфун может понижать трафик без явного предупреждения.

Подключите антибот-сервис. Зарегистрируйтесь в BotHunt, добавьте сайт, установите агент (один скрипт или плагин WordPress). Первые 30 минут сервис проходит калибровку, дальше начинает активно фильтровать.

Мониторинг. Первые 7 дней внимательно смотрите на дашборд: какой процент трафика оказался ботами, какие типы угроз преобладают, нет ли ложных срабатываний на ваших реальных клиентов. Настройте белый список для корпоративных сетей, если они есть.

Коммуникация с Яндексом. Если уведомление в Вебмастере было — через 2–3 недели чистого трафика отправьте обращение в поддержку, приложив отчёт BotHunt о блокировках. Это ускоряет снятие ограничений.

Контроль. Раз в неделю просматривайте отчёт «Угрозы» в дашборде BotHunt и «Роботы» в Метрике. Сопоставление двух источников даёт полную картину.

Типичная картина после внедрения защиты: в первые 3–5 дней в дашборде видно, сколько поведенческих ботов приходило на сайт до этого момента — обычно 10–30% всего трафика из Яндекса. Через 2 недели сбрасываются искажённые метрики в Метрике, а через 3–4 недели алгоритмы Яндекса начинают доверять сигналам сайта больше и позиции ползут вверх. Это не одномоментный скачок, но устойчивый тренд.

Частые ошибки владельцев сайтов при внедрении защиты

В нашей практике мы видим одни и те же ошибки, которые сводят на нет даже хороший антибот-сервис. Вот чек-лист, чего делать не стоит.

Ошибка | Почему плохо | Как правильно |

|---|---|---|

Поставить reCAPTCHA v2 на весь сайт | Убивает конверсию, ботов всё равно не ловит | Проактивная защита без капчи |

Заблокировать все IP из дата-центров | Отрежет живых клиентов с VPN и мобильными | Использовать ASN + поведение вместе |

Ориентироваться только на Метрику | Метрика видит ботов постфактум | Использовать Метрику как сигнал, не как щит |

Реагировать только на уведомление Вебмастера | К этому моменту позиции уже просели | Профилактика: защита до инцидента |

Включить жёсткий rate limit 10 req/min | Режет мобильных пользователей (NAT) | Адаптивный лимит на основе score |

Блокировать YandexBot по ошибке | Сайт выпадет из индекса | Белый список по обратному DNS |

Особенно хотим подчеркнуть пункт про капчу. На конференциях 2025 года Яндекс неофициально подтверждал: агрессивная капча на входе — скорее сигнал проблемы для алгоритма, чем её решение. Тайфун анализирует не только поведение ботов, но и реакцию сайта: массовые блокировки живого трафика выглядят подозрительно и снижают поведенческие показатели ещё сильнее.

Ещё одна частая ошибка — ставить защиту только на лендинг и «забыть» про блог или категории каталога. Накрутчики работают по всем страницам, ранжирующимся в Яндексе, включая статейные разделы. Защищать надо весь домен. В BotHunt агент устанавливается один раз, и покрывает всё без дополнительных настроек для отдельных разделов.

Хотите убедиться, что на вашем сайте нет поведенческих ботов прямо сейчас? Подключите BotHunt, и за первые сутки вы увидите реальную долю бот-трафика. Подключить защиту →

Часто задаваемые вопросы

Что такое накрутка поведенческих факторов и чем она опасна для сайта?

Накрутка поведенческих факторов — это заход ботов на ваш сайт из выдачи Яндекса с имитацией действий человека (клики, скролл, переходы), чтобы поднять или обрушить позиции. Для сайта-жертвы это означает ухудшение реальных метрик в Метрике, риск попадания под алгоритм Тайфун и потерю трафика на 8–18 месяцев. Поэтому защита от накрутки поведенческих факторов сегодня так же важна, как SSL-сертификат.

Как понять, что сайт атакуют боты, накручивающие ПФ?

Признаки атаки: всплеск визитов из поиска без роста заказов, аномально короткие сессии, странная география (города, где у вас нет клиентов), высокий процент отказов, уведомление «Обнаружена имитация действий пользователей» в Яндекс Вебмастере. Подробнее — в нашей статье «8 признаков поведенческих ботов на сайте».

Справится ли обычная капча с накруткой поведенческих факторов?

Нет. Современные накрутчики на Browser Automation Studio и ZennoPoster обходят reCAPTCHA v3 и SmartCaptcha, а ставить капчу на каждый заход из Яндекса — значит уронить конверсию и живого трафика тоже. Нужна проактивная фильтрация по fingerprint, поведению и ASN до того, как пользователь видит контент.

Поможет ли блокировка по IP или User-Agent?

Частично. Простые боты отсекаются, но серьёзная накрутка идёт через резидентные прокси с чистой ASN-репутацией и ротацию User-Agent. За 2–3 дня защита по статичным правилам перестаёт работать. Нужна поведенческая аналитика, которая смотрит на то, как клиент ведёт себя, а не только откуда пришёл.

Что делать, если уже пришло предупреждение в Яндекс Вебмастере?

Сначала подтвердить, что накрутка идёт против вас, а не от вас (чёрный SEO-специалист мог действовать без ведома владельца). Затем включить защиту от поведенческих ботов, собрать доказательства (логи, скриншоты всплесков) и отправить их в поддержку Яндекса через форму в Вебмастере. Подробный разбор — в нашей отдельной статье о снятии фильтра.

Насколько точно BotHunt отличает бота от реального пользователя?

По нашим данным на трафике клиентов, точность детекции поведенческих ботов — 99,9% при уровне ложных срабатываний ниже 0,05%. Мы используем многослойную модель: TLS-fingerprint, canvas, поведенческая аналитика, репутация ASN. Решение принимается за <100 мс и не требует капчи.

Влияет ли защита от накрутки ПФ на индексацию сайта Яндексом?

Нет, если настроить белый список. BotHunt поддерживает корректную идентификацию YandexBot, GoogleBot и других поисковых роботов через обратный DNS — они всегда проходят. Блокируются только клиенты, которые выдают себя за поисковик или пытаются маскировать автоматизацию. Официальные рекомендации Яндекса по работе с роботами описаны в справке Яндекс Вебмастера.

Сколько времени занимает внедрение защиты и когда виден эффект?

Установка агента BotHunt занимает 1–5 минут: одна строка кода на сайт или плагин WordPress. Первые 30 минут сервис калибруется на вашем трафике, дальше начинает активно фильтровать. В Яндекс Метрике чистый трафик виден уже на следующий день, восстановление позиций — обычно через 14–30 дней после старта защиты.